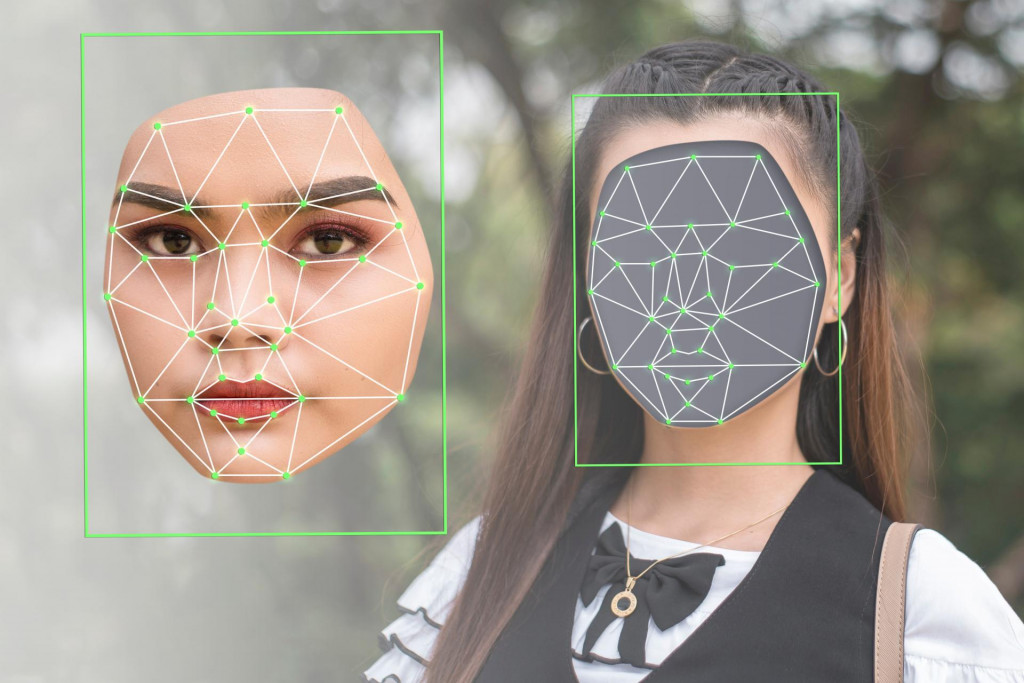

Podvodné telefonáty či textové správy sú tu s nami už prakticky od vzniku týchto technológií. Avšak v poslednej dobe rastie potenciál pre falošné videohovory, v ktorých sa druhá strana môže vydávať za niekoho vám blízkeho či inak známeho (tzv. deepfake).

Pomáha im v tom umelá inteligencia, ktorá už vie napodobniť iného človeka, a to dokonca v reálnom čase. Výskumníci však už prišli na celkom elegantnú obranu.

Singapurská štúdia odhaľuje riešenie, ktoré má za cieľ „rozhodiť“ umelú inteligenciu pomocou náhodných rýchlych pohybov (trasenie telefónom) predovšetkým silnými vibráciami zariadenia. To je niečo, čo dokáže každý mobil. Ak vám volá niekto s tvárou napodobňujúcou iného človeka, vibrácie môžu umelú inteligenciu zmiasť natoľko, že potom špecializovaný program dokáže rýchlo vyhodnotiť situáciu a upozorniť na podvod.

Využije slabinu umelej inteligencie

Funguje to tak, že zhromaždené dáta, ktoré vytvárajú falošný obraz, nevedia rýchlo reagovať na otrasy. Simulovaná tvár teda bude mať aj počas vibrovania telefónu ostrejšie rysy, než keby telefón snímal skutočného človeka, v takom prípade by jeho tvár bola znateľne rozmazanejšia. Stačí tak, aby služba, cez ktorú sa títo dvaja ľudia rozprávajú, poslala pokyn na zavibrovanie telefónu podvodníka, a následne vyhodnotila zozbierané dáta.

Umelá inteligencia sa síce môže takýmto situáciám čiastočne brániť tým, že do cvičných dát zahrnie aj rozmazané tváre (či simuluje takzvaný motion blur, teda rozmazanie pohybu), lenže stále nevie natoľko rýchlo a spoľahlivo reagovať na náhodné otrasy.

Reálna hrozba

Metóda s vibráciami telefónu, ktorú popisujú výskumníci, výrazne lepšie odhaľuje podvody oproti iným, v súčasnosti používaným nástrojom. Potenciál tejto hrozby pritom rýchlo rastie, ako dokazuje prípad zo začiatku tohto roku, keď sa stal obeťou takéhoto podvodu úradník z Hongkongu. Ten na povel falošného riaditeľa vo videohovore odoslal 25 miliónov dolárov na účet podvodníka.

V budúcnosti môže takýchto situácií pribúdať, pretože ľudia sú stále častejšie ochotní veriť komunikácii „tvárou v tvár“, hoci sprostredkovanou pomocou videa. Doteraz sa však takéto podvody odohrávali predovšetkým v prostredí so statickými kamerami (napríklad webkamera v konferenčnej miestnosti), je však len otázkou času, kedy sa takéto situácie začnú stávať aj na obrazovkách telefónov držaných v ruke. V takom prípade potom príde metóda na odhalenie podvodu určite vhod.